Razer, die führende globale Lifestyle‑Marke für Gamer, hat auf der News- und Demo‑Bühne des GDC Festival of Gaming ihren „Future of Play“ Showcase enthüllt und eine einheitliche KI‑gestützte Entwicklungsinfrastruktur vorgestellt, die Software, Hardware und multisensorische Immersion verbindet.

Mit einem prognostizierten globalen Spielemarkt von 206,5 Milliarden US-Dollar im Jahr 2028 und fast vier Milliarden Spielern weltweit setzen Studios verstärkt auf KI, um schneller zu entwickeln und gleichzeitig hohe Qualität zu gewährleisten. Razers GDC‑Showcase 2026 konzentriert sich auf drei neue Lösungen, die Entwicklern die Kontrolle überlassen und gleichzeitig Reibungspunkte im Entwicklungsprozess reduzieren:

- Razer AVA führt neue agentische Funktionen ein, die Nutzerintentionen in zielorientierte, mehrstufige Workflows über Apps, Dienste und Geräte hinweg übersetzen.

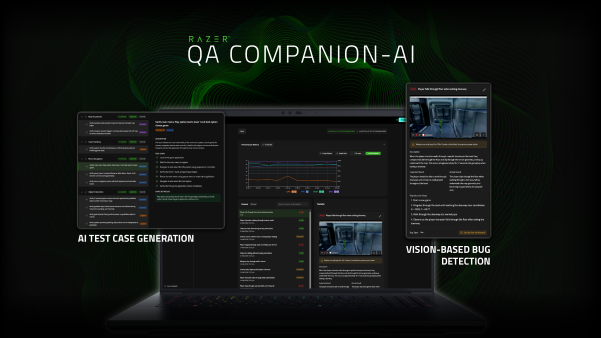

- Razer QA Companion‑AI liefert jetzt Zero‑Integration‑QA mit visuellen Testverfahren und automatisierter Bug‑Ermittlung inklusive Reproduktionsschritten und KI-generierten Test Cases.

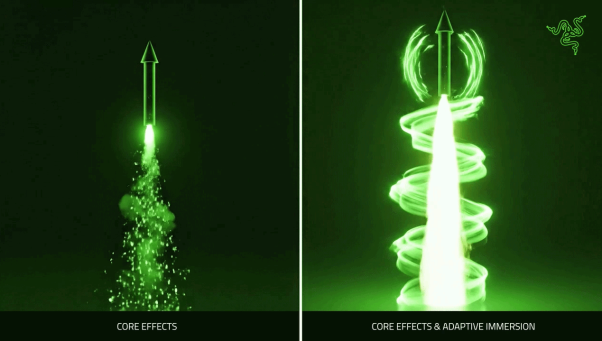

- Razer Adaptive Immersive Experience bietet ein intelligentes multisensorisches Runtime‑System, das von Entwicklern erstellte Effekte mit Echtzeit‑adaptiver Haptik, Beleuchtung und Audio vereint.

„KI soll menschliche Kreativität verstärken, nicht ersetzen. Dieser Grundsatz prägt alles, was wir im Bereich Hardware, Software und Services entwickeln“, sagt Quyen Quach, VP Software bei Razer. „Wir entwickeln praktische KI‑Tools, die Entwicklern die volle Kontrolle geben und Teams dabei helfen, schneller von der Idee zur Umsetzung zu gelangen und dabei das handwerkliche Können bewahren, das Spiele unvergesslich macht. Von agentischen Begleitern über reibungsfreie QA bis hin zu adaptiver multisensorischer Immersion ist unser Ziel einfach: Studios dabei zu unterstützen, schneller zu entwickeln, die Abdeckung zu erhöhen und noch mitreißendere Erlebnisse zu liefern.“

Gemeinsam verdeutlichen diese Säulen Razers übergeordnetes Engagement, eine umfassende Gaming‑Infrastruktur aufzubauen, die Hardware, Software und Services für immersive Spielerlebnisse miteinander verbindet.

Razer AVA: Vom KI‑Gaming‑Copilot zum agentischen Desktop‑Begleiter

2025 als Project AVA vorgestellt und später auf der CES 2026 als 5,5‑Zoll‑animierter 3D‑Hologramm‑Schreibtischbegleiter erneut präsentiert, entwickelt sich Razer AVA nun zu einem noch leistungsfähigeren agentischen Assistenten weiter, mit der Fähigkeit, Ziele zu verstehen, Aufgaben zu planen und über die Apps, Dienste und Geräte eines Nutzers hinweg zu handeln.

Auf der GDC 2026 präsentiert AVA ein erweitertes agentisches System, das Nutzerintentionen in strukturierte, mehrstufige Workflows übersetzt und die Erfahrung damit von einfachen Chat‑Antworten hin zu echter Aufgabenbearbeitung weiterentwickelt. Dadurch wird AVA von einem reaktiven Begleiter zu einem praktischen KI‑Assistenten für den täglichen Einsatz, sowohl für professionelle Anwender als auch für Gamer.

Zu den zentralen Funktionen gehören:

- Angetrieben vom neuen Razer Inference Control Plane: Leitet Anfragen intelligent zwischen lokalen und Cloud‑Modellen weiter. Für geringere Latenz, nahtlose Multi‑Step‑Prozesse und effiziente Ausführung bei zunehmender Aufgabenkomplexität.

- Integration von Drittanbieter‑Apps und ‑Diensten: Kann mit unterstützten Services, Chat‑Plattformen und Apps wie Spotify interagieren, um im Auftrag des Nutzers zu handeln, inklusive Echtzeit‑Reaktionen.

- Agentische Workflows: Plant und führt mehrstufige Aufgaben autonom aus und verwandelt Intentionen in abgeschlossene Tasks über alle verbundenen Tools hinweg.

- Companion‑zu‑Companion‑Koordination: Ermöglicht agentische Kommunikation zwischen AVA Companions, sodass diese Ende‑zu‑Ende‑Aufgaben über mehrere Nutzer hinweg koordinieren können, wie etwa Terminvorschläge, Kalenderbuchungen oder Terminbestätigungen.

Indem AVA Setup‑Arbeiten, Abstimmungen und andere alltägliche Routineaufgaben übernimmt, erleichtert der Assistent den Nutzerinnen und Nutzern ihren Alltag – und verschafft ihnen mehr Zeit für das, was wirklich zählt.

Anmeldungen für die Razer AVA‑Beta auf Razer Cortex sind ab sofort möglich. Early‑Access‑Einladungen werden ab Q2 2026 an ausgewählte Nutzerinnen und Nutzer versendet.

Razer QA Companion‑AI: Zero‑Integration‑Qualitätssicherung für moderne Pipelines

Erstmals auf der GDC 2025 vorgestellt, erhält der Razer QA Companion‑AI nun bedeutende Erweiterungen, die den Workflow weiter vereinfachen und die automatisierte Testabdeckung für moderne Entwicklungsumgebungen erhöhen. Mit neuen Zero‑Integration‑ und visuell basierten Testfunktionen fügt sich die Lösung nahtlos in bestehende QA‑Abläufe ein, ohne SDKs, Plugins oder Codeänderungen.

Diese neuen Funktionen beschleunigen QA‑Prozesse, indem sie die Automatisierung erhöhen, die Vollständigkeit von Reports verbessern und den manuellen Aufwand für Tester reduzieren. Sie bauen auf den bisherigen Möglichkeiten des QA Companion‑AI auf, Gameplay‑Material zu analysieren, visuelle Fehler zu erkennen und automatisch vollständige Bug‑Reports samt Video zu generieren – nun inklusive reproduzierbarer Schritte für jeden Eintrag. Das System kann außerdem Testfälle aus Prompts oder Game‑Design‑Dokumenten (GDDs) generieren, während KI‑Gameplay‑Agenten in Entwicklung sind, die ausgewählte Testfälle ausführen und pass/fail‑Ergebnisse zurückliefern. Gemeinsam helfen diese Funktionen Studios dabei, QA‑Prozesse zu beschleunigen, ohne dafür Genauigkeit, Kontrolle oder kreative Intentionen opfern zu müssen.

Zu den wesentlichen Erweiterungen gehören:

- Zero‑Integration‑Deployment: Funktioniert sofort, ohne SDK, Plugin oder Codeanpassungen.

- KI‑Testfall‑Generierung: Erstellt funktionale, negative und Grenzwert‑Testfälle aus Tester-Prompts oder optionalen GDD‑Eingaben, in wenigen Minuten generiert und adaptierbar für verschiedene Titel.

- Visuelle Fehlererkennung: Analysiert Gameplay‑Material, identifiziert visuelle Probleme (z. B. Physik‑ und Kollisionsfehler, Rendering‑ oder Animationsfehler) und erzeugt vollständige Bug‑Reports inklusive Reproduktionsschritten und Video.

- KI‑Gameplay‑Agenten: Autonome, spielbewusste Agenten, die ausgewählte Testfälle ausführen, sich an Designänderungen anpassen und ohne Skrpting pass/fail‑Zusammenfassungen liefern.

- Einfache Einrichtung: Ein unkomplizierter Ablauf mit einer einmaligen Installation der Bridge‑App, ohne Abhängigkeiten von Drittanbieter-Software.

Durch die Automatisierung repetitiver Aufgaben und Reportings erweitert der QA Companion‑AI die Testabdeckung, beschleunigt QA‑Zyklen und ermöglicht es Testern, sich auf wertorientiertes, spielerzentriertes Testing zu konzentrieren.

Razer Adaptive Immersive Experience: Ein neuer Standard für multisensorisches Gameplay

Razer Adaptive Immersive Experience ist ein neues multisensorisches Runtime‑System, das eine Plug‑and‑Play‑Effektbibliothek mit in Echtzeit generierten ambienten Haptik‑ und Beleuchtungseffekten kombiniert. Es reduziert Integrations‑ und Abstimmungsaufwand auf bis zu drei Tage und bietet Entwicklern eine schnellere und konsistentere Möglichkeit, hochwertige multisensorische Erlebnisse zu liefern, ohne zusätzlichen Produktionsaufwand.

Als Teil des Razer‑Entwicklerökosystems WYVRN führt Adaptive Immersive Experience eine adaptive Ebene der Immersion ein, die nahtlos mit von Designern erstellten Effekten zusammenarbeitet. Das Runtime‑System interpretiert Audio‑ und visuelle Signale des Spiels in Echtzeit und mischt einen kontextsensitiven ambienten Basiseindruck mit handgefertigten Momenten. So bleibt die Immersion ausgewogen, reaktiv und konsistent, während sich das Gameplay entfaltet. Aufbauend auf Razers multisensorischem Stack aus Razer Sensa™ HD Haptics, Razer Chroma™ RGB und THX Spatial Audio+ verstärkt das System das Spielerlebnis, ohne die kreative Vision eines Studios zu überschreiben.

Adaptive Immersive Experience führt außerdem Dynamic Haptics ein, eine Technologie, die von Entwicklern erstellte Sensa‑HD‑Haptik‑Effekte mit Audio‑to‑Haptics (A2H), einer Echtzeit‑Engine zur Umwandlung von In‑Game‑Audio in taktiles Feedback, vereint. Gemeinsam sorgen diese Systeme für ein reichhaltigeres, konsistenteres haptisches Erlebnis, sowohl bei handgefertigten Spielmomenten als auch im ambienten Umfeld.

Zu den wesentlichen Funktionen gehören:

- In Echtzeit generierte Effekte: Adaptive ambient‑Haptik und Beleuchtung werden automatisch vom Runtime‑System erzeugt, was manuellen Skriptaufwand reduziert und dennoch sicherstellt, dass designte Effekte klar im Vordergrund bleiben.

- Plug‑and‑Play‑Effektbibliothek: Eine produktionsreife Sammlung an Haptik‑ und Chroma‑Effekten, validiert in veröffentlichten Titeln und vollständig kompatibel mit Unity und Unreal Engine.

- Native Wwise‑Integration: Direkte Unterstützung für Sensa HD Haptics und THX Spatial Audio+ innerhalb etablierter Wwise‑Audioworkflows.

Durch die intelligente, kontextbasierte Anpassung von Beleuchtung, Haptik und Audio in Echtzeit bietet Adaptive Immersive Experience Entwicklern eine schnellere, skalierbarere Möglichkeit, konsistente multisensorische Immersion über jedes Spiel hinweg zu realisieren und schafft zugleich die Grundlage für noch tiefgreifendere und ausdrucksstärkere Erlebnisse in der Zukunft.

Adaptive Immersive Experience wird ab Q1 2026 schrittweise ausgerollt.

Erlebe die Zukunft des Gamings mit Razer: Menschliche Kreativität unterstützt von KI auf der GDC 2026

Die GDC ist der Ort, an dem neue Formen der Interaktion entstehen. Bei Razers GDC‑Showcase erleben Besucher Live‑Demos, technische Deep Dives und Hands‑on‑Sessions zu AVA, QA Companion‑AI und der Adaptive Immersive Experience – von agentischen KI‑Begleitern über integrationsfreie QA bis hin zu adaptiver multisensorischer Immersion, alles an einem Ort. Weitere Informationen unter rzr.to/GDC2026.